Claude Code 使用 Claude Code Router 对接本地模型完全指南

随着 AI 技术的快速发展,越来越多的开发者希望在本地环境中部署和使用大型语言模型。Claude Code 作为 Anthropic 推出的强大 AI 编程助手,通过 Claude Code Router (CCR) 可以轻松连接到本地部署的模型,实现离线使用和更好的隐私保护。

本文将详细介绍如何通过 CCR 将 Claude Code 连接到本地部署的 DeepSeek-V3.1-Terminus 模型,让你在没有网络连接的情况下也能享受高质量的 AI 编程辅助。

你将学到:

- Claude Code Router 的基本概念和工作原理

- 如何在服务器上部署 DeepSeek-V3.1-Terminus 模型

- 完整的 CCR 配置方法和参数调优

- 常见问题排查和性能优化技巧

1. 环境准备和工具安装

1.1 安装 Claude Code

首先需要在你的开发机器上安装 Claude Code:

| |

1.2 安装 Claude Code Router

Claude Code Router 是一个 Node.js 包,用于桥接 Claude Code 和本地模型:

| |

1.3 验证安装

安装完成后,验证两个工具是否正常工作:

| |

2. 模型部署

2.1 模型下载

在服务器上下载 DeepSeek-V3.1-Terminus 模型:

| |

2.2 vLLM 服务启动

使用 vLLM 框架部署模型服务,确保已安装 GPU 驱动和 NVIDIA Container Toolkit:

| |

关键参数说明:

- GPU 配置:根据实际 GPU 数量调整

--gpus参数 - 内存共享:

--shm-size 16g确保容器有足够共享内存 - 模型长度:

--max-model-len 128000设置支持长上下文 - 工具调用:

--enable-auto-tool-choice和--tool-call-parser deepseek_v31启用工具调用功能 - 聊天模板:使用 DeepSeek V3.1 专用的工具调用模板

- 张量并行:

--tensor-parallel-size 4在多 GPU 上并行处理

模板文件获取: 从 vLLM 官方仓库下载:tool_chat_template_deepseekv31.jinja

2.3 服务验证

部署完成后,验证服务是否正常运行:

| |

如果一切正常,你应该能看到模型的响应输出。

2.4 配置 Claude Code Router

配置说明

核心配置文件如下:

| |

- Providers:对接不同供应商提供的不同模型

- Router:则是将模型分类 https://musistudio.github.io/claude-code-router/zh-CN/docs/server/config/routing

- default:默认路由

- background:后台任务,推荐用轻量级模型

- think:思考密集型任务,推荐用能力强的模型

- longContext:长上下文时会使用该模型

- webSearch:网络搜索任务

- image:图像任务

完整配置

创建或编辑配置文件 ~/.claude-code-router/config.json:

| |

配置说明:

- API 地址:将

your-server-ip替换为实际的服务器 IP 地址 - API 密钥:设置与 vLLM 启动时相同的 API 密钥

- 路由配置:将所有任务类型都指向本地模型

- 状态栏:启用自定义状态栏显示工作目录、Git 分支、模型信息等

- 日志级别:调试阶段可设为

debug,生产环境建议改为info

3. 开始使用

3.1 启动 Claude Code Router

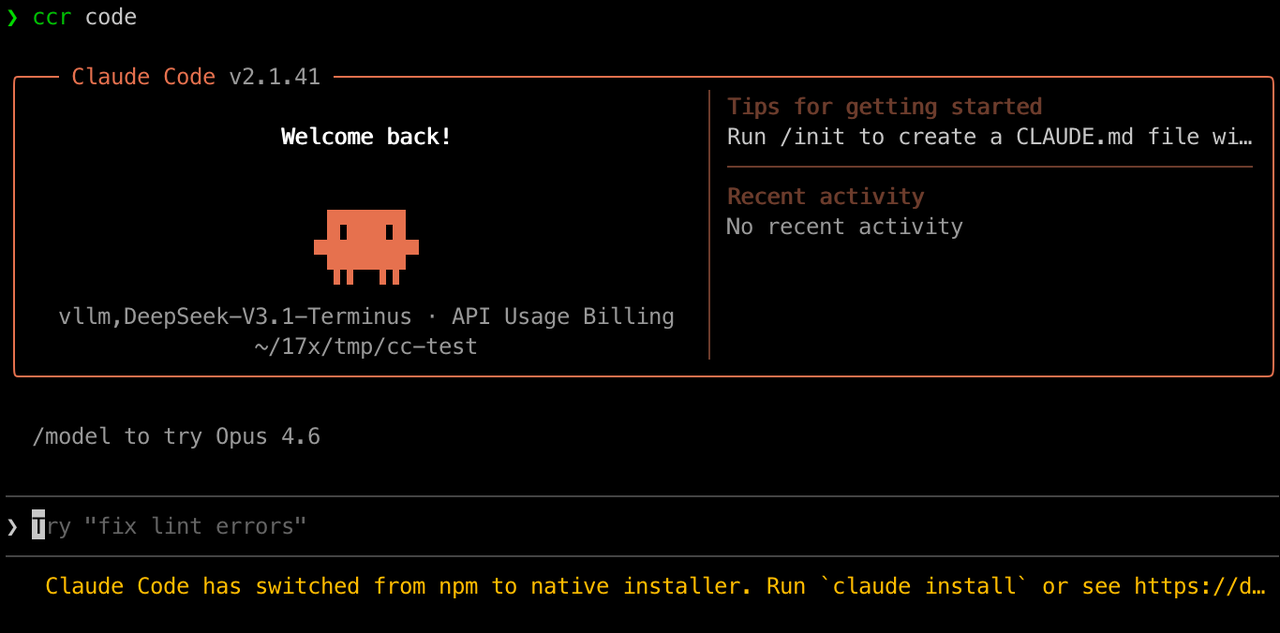

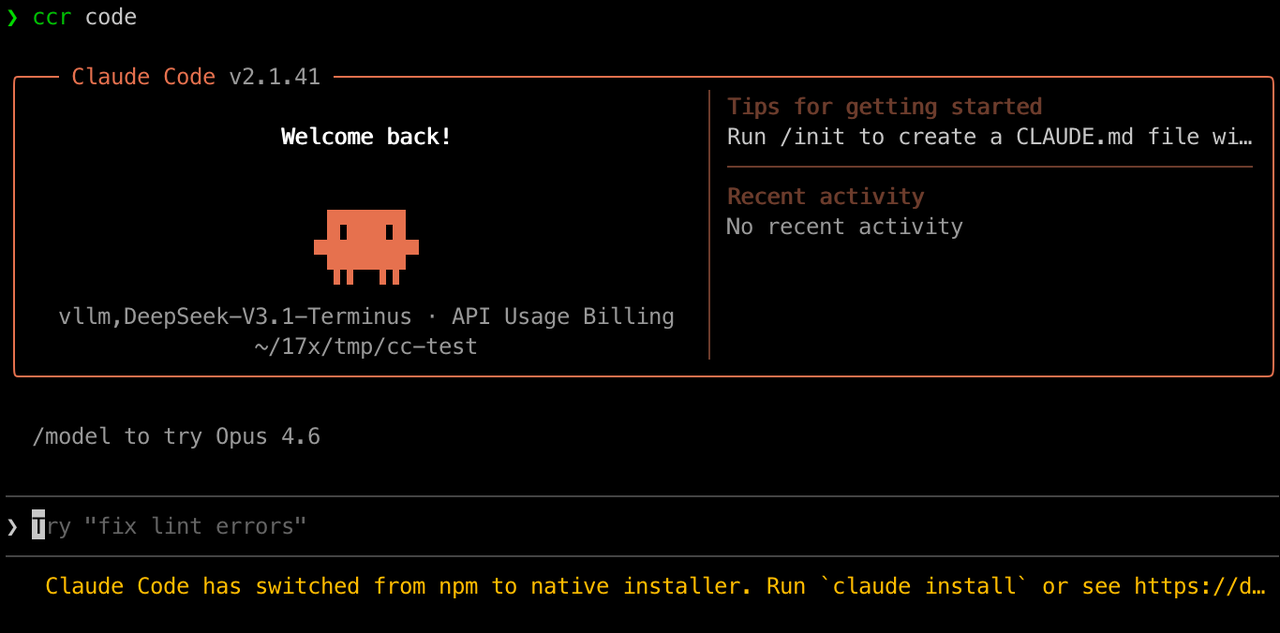

使用 ccr code 替代原来的 claude 命令:

效果如下:

启动后,在 claude 界面输入以下命令切换模型

| |

之后就可以正常使用了。

ps: 不切换模型也可以,只是终端会一直显示用的 Claude 的模型。

4. 常见问题与解决方案

4.1 “Unable to connect to Anthropic services” 错误

如果运行 ccr code 时报错:“Unable to connect to Anthropic services”,可以修改 ~/.claude.json 文件,在最外层添加以下配置:

| |

保存后重新运行即可。

5. 小结

本文详细介绍了如何通过 Claude Code Router 将 Claude Code 连接到本地部署的 DeepSeek-V3.1-Terminus 模型,实现了完全离线的 AI 编程助手体验。整个过程涵盖了从环境准备、模型部署到最终使用的完整链路。

除了本地模型之外,Claude Code Router 还支持对接其他 Provider,例如 ModelScope、DeepSeek、ZhipuAI、OpenAI 等等。